چند درصد از معاشرتهای آنلاین ما واقعی است؟

نظریه اینترنت مرده چیست؟

نظریه اینترنت مرده در سادهترین حالت میگوید که اکثریت قریببهاتفاق ترافیک اینترنت، پستها و کاربران واقعی با رباتها و محتوای تولیدشده توسط هوش مصنوعی جایگزین شدهاند و دیگر انسانها مسیر اینترنت را شکل نمیدهند.

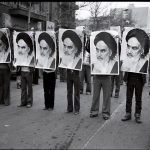

این نظریه اواخر دههی ۲۰۱۰ در وبسایت 4chan که به کاربران اجازه میداد بهصورت ناشناس پست بگذارند و دربارهی موضوعات مختلف بحث کنند، مطرح شد؛ اما سال ۲۰۲۱ پس از انتشار یک پست طولانی در فروم کافه مکینتاش آگورا رود با عنوان «تئوری اینترنت مرده: بیشتر اینترنت فیک است» نظر مردم، رسانهها و کارشناسان بیشتری را به خود جلب کرد.

آگوست ۲۰۲۱ کیتلین تیفانی در وبسایت آتلانتیک این پست را نوعی «مرجع اصلی» توصیف کرد که پایهواساس و ساختار نظریه را برای آیندگان بنا مینهاد. تیفانی حتی موفق شد با نویسندهی اصلی، مردی کالیفرنیایی که ادعا میکرد صادقانه به نوشتههای خود باور دارد، ارتباط برقرار کند.

تئوری اینترنت مرده قبل از انتشار تجاری چتباتهای هوشمصنوعی مطرح شد

پست او حاوی احساس ناراحتی، پارانویا و تنهایی بود و ناامیدی عمیقی را از وضعیت اینترنت مدرن بیان میکرد. او میگفت که هوش مصنوعی با موفقیت اکثر فعالیتهای انسانی آنلاین را از بین برده و اینترنت را به مدلی کنترلشده و الگوریتمی تبدیل کرده که صرفاً اهدافی نظیر «فروش محصولات و ایدهها» را دنبال میکند.

اما نظریه فراتر از محکومکردن اینترنت امروز بهعنوان محتوای کسلکنندهی شرکتی بسط مییابد:

این پست پیشنهاد میکند که ما بهندرت در اینترنت با انسانهای واقعی تعامل داریم یا حتی پستهای خلق شده توسط آدمها را میبینیم. او همچنین از ایدههای عجیبی حرف میزند، از جمله اینکه محبوبیت میمهایی مانند Raptor Jesus ،Foul Bachelor Frog و Pepe the Frog شواهدی از یک حیات هوش مصنوعی در حال تکامل است که شکل خود را تغییر میدهد.

در بخشهایی از این پست میخوانیم:

اینترنت خالی و عاری از مردم به نظر میرسد. همچنین عاری از محتواست. در مقایسه با اینترنت مثلاً سال ۲۰۰۷ (و بعد از آن)، اینترنت امروز کاملاً استریل و بیروح شده و دیگر جایی برای رفتن و چیزی برای دیدن، خواندن یا تجربه کردن وجود ندارد. تمام اینترنت محدود شده به چند سایت معمولی و پیشپاافتاده و این فضاهای خالی که ما در آنها پرسه میزنیم. بله، شاید اینترنت عظیم و غولآسا به نظر برسد، اما مثل یک بالن هوای داغ است که هیچ چیز داخلش نیست. بخشی از این مطمئناً تقصیر شرکتها و نهادهای دولتی است. با این حال این موضوع موارد زیر را توضیح نمیدهد:

اینترنت روی گوشی هوشمند شما همان اینترنت روی کامپیوتر شما نیست. خودتان امتحان کنید. به یک وبسایت «محبوب» با ترافیک زیاد بروید. فرقی ندارد، به فورچن، فیسبوک، ردیت یا هر سایت دیگری بروید که کاربران زیاد و محتوای سریعی دارد. برای چند روز این وبسایت را به طور تصادفی هم روی کامپیوتر و هم روی گوشی خود چک کنید. به زودی متوجه خواهید شد که گاه به گاه، در فواصل نامنظم (تا جایی که من شاهد بودهام) سایتی که روی گوشی مشاهده میکنید با نسخهای که در کامپیوترتان میبینید، متفاوت است. برای مثال شاید پستهایی کامل را ببینید که واکنشها و پاسخهای زیاد و خوبی دریافت کردهاند، ولی همان پستها در دستگاه دیگر اصلا وجود ندارند. گاهی کل صفحه و محتوای آن در دو دستگاه کاملا متفاوت است و این تفاوتها تصادفی نیستند.

افراد جعلی. منظورم NPCها نیست. یوتیوبرهایی که درمورد همهچیز صحبت میکنند و احتمالاً بسیاری از سیاستمداران، بازیگران و نظیر آن ممکن است واقعاً وجود نداشته باشند. در واقع من از این موضوع مطمئنم. تصاویر تولیدشده با کامپیوتر (CGIها) و دیپ فیکها بسیار پیشرفتهتر از آن چیزی هستند که به ما میگویند. دیگر نمیتوانیم به چشمهایمان اعتماد کنیم. احتمال دارد بسیاری از افراد، رویدادها، اخبار و غیره کاملاً ساختگی باشند.

داستانهای الگوریتمی. از فیلمهای ابرقهرمانی خوشتان میآید؟ نظرتان درمورد بقیهی تولیدات هالیوودی چیست؟ در مورد موسیقی چطور؟ متوجه شدهاید داستانها چقدر بیروح و خالی شدهاند؟ چطور همهچیز برای رضایت سادهترین و سطحیترین مخاطبها ساخته میشود و مدام یک الگوی تکراری را دنبال میکند؟ چطور موسیقی فقط به اتوتیون و آهنگهای عامهپسند و عادی محدود شده؟ الگوریتمها و برنامههای کامپیوتری داستانهای مدرن را تولید میکنند. هیچ انسانی پشت این چیزها نیست. به همین دلیل است که انیمهها این قدر برجسته و تأثیرگذار به نظر میرسند: حتی یک انیمهی ساده نیز روح دارد، چون افراد واقعی پشت آن هستند و ما همه به طور غریزی این را حس میکنیم.

شاید پذیرفتن آخرین شک و گمان من برایتان سادهتر باشد. حس میکنم ما در میانهی نوعی جنگ داخلی عجیب قرار داریم. یک جنگ درونی در دنیای اینترنت. فکر میکنم زاکربرگ و سایر اشخاص مشهور تکنولوژی، همی زمانی کاربران ناشناس فورچون بودهاند و شاید هنوز هم باشند. آنها از همان منبعی آب خوردند که ما خوردیم (در همان فضاهای آنلاین ما وقت میگذراندند و از همان فرهنگ اینترنتی تغذیه میکردند)، ولی راه متفاوتی را رفتند (تا کنترل فضا را دردست بگیرند و آن را به نفع خودشان تغییر دهند).

تئوری اینترنت مرده میگوید انسانها دیگر مسیر اینترنت را شکل نمیدهند

البته تاریخ این پست به قبل از انتشار تجاری ChatGPT و قبل از اینکه هوش مصنوعی به موضوع داغ گفتگو تبدیل شود، برمیگردد، گرچه مباحث پیرامون باتها همیشه با گمانهزنیهای زیادی همراه بود.

بااینحال اغلب ما زمان وبگردی و چککردن شبکههای اجتماعی، با اتفاقات مشابه و الگوهای عجیبی برخورد کردهایم و حتی تجربیات دیگران را هم در این زمینه خواندهایم: پستهایی که به طرز مشکوکی در چند دقیقه هزاران لایک میگیرند، کامنتهایی که انگار از یک دستورالعمل پیروی میکردند، و محتوایی که به نظر میرسد برای هیچ مخاطب واقعیای تولید نشده است.

همچنین طبق گزارشها، در سال ۲۰۲۴ بیش از ۵۴ درصد از پستهای بلند انگلیسیزبان لینکدین را هوش مصنوعی نوشته بود. ضمن اینکه این افزایش قابلتوجه تقریباً از زمان انتشار ابزارهای هوش مصنوعی مانند چتچیپیتی آغاز شده، چنانکه در این مدت حجم محتوای به اشتراکگذاشته در این پلتفرم ۱۸۹ درصد و متوسط طول پستها ۱۰۷ درصد افزایشیافته است.

پیرو این جریانهای سریالی، تعداد زیادی از هنرمندان و نویسندگان شکایت کردند که اینترنت پر شده از تصاویر تولیدشده توسط هوش مصنوعی که هیچ ارزشی جز «جدید بودن» ایجاد نمیکنند و همینطور محتوای متنی AI که هیچکس واقعاً نمیخواهد بخواند.

بیش از ۵۴ درصد از پستهای بلند لینکدین را در سال ۲۰۲۴ هوش مصنوعی نوشته است

اما اگر این اتفاقات فقط نوک کوه یخ باشند، چه؟ هر روز میلیونها پست، کامنت و لایک توسط شبکهای پیچیده از باتها منتشر میشود. این محتوای مصنوعی چنان با محتوای واقعی درهمآمیخته که تشخیص مرز بین آنها تقریباً غیرممکن شده و این دقیقاً همان چیزی است که تئوری اینترنت مرده دربارهاش هشدار میدهد: ما دیگر نمیدانیم چه چیزی واقعی است و چه چیزی مصنوعی.

مدلهای پیشرفتهای مانند ChatGPT و Gemini اکنون میتوانند مقالات، پستهای وبلاگی و حتی کتاب تولید کنند و سیستمهای آموزشی را به فکر بیندازند که باید با پایاننامههایی که با هوش مصنوعی نوشته شده، چه کنند؟

فراتر از متن، مدلهایی مانند DALL-E و میدجرنی قادر به تولید تصاویری باورنکردنی هستند. ویدیوهای دیپفیک بهراحتی باکیفیت بالا تولید میشوند و در برخی موارد صدای مصنوعی چنان پیشرفت کرده که نمیتوان آن را از صدای واقعی تشخیص داد.

از هجوم باتهای توییتری تا تصاویر بیارزش تولید شده با هوش مصنوعی، محتوا و تعاملات آنلاین امروزی چقدر پایهی واقعی دارند؟

طنز تلخ ماجرا: شاید شما همین حالا از خودتان بپرسید آیا این مطلب را انسانی واقعی نوشته یا هوش مصنوعی و این تردید بهترین گواه بر صحت تئوری اینترنت مرده محسوب میشود. (نگران نباشید؛ پشت این مطلب یک نویسندهی واقعی است!)

نکتهی تأملبرانگیز این بود که منتقدان از همان زمان معرفی این فناوریها پیشبینی کردند که انبوهی از محتوای بیارزش تولید شده توسط هوش مصنوعی، اینترنت را پر خواهد کرد. حالا این پیشبینیها کمکم به واقعیت تبدیل میشوند. درست مانند وقتی که تودهای عظیم از زبالههای پلاستیکی روی اقیانس شناور میشود، محتوای بیارزش تولید شده توسط هوش مصنوعی نیز در حال بالا آمدن به سطح اینترنت است.

سایهی سنگین باتها: از سیاست تا اقتصاد

تئوری اینترنت مرده زمانی نگرانکنندهتر میشود که پای سیاست و اقتصاد به میان میآید. شواهد نشان میدهد باتها و محتوای مصنوعی نهتنها برای سرگرمی، بلکه بهعنوان ابزاری قدرتمند برای شکلدادن به افکار عمومی و دستکاری بازارها استفاده میشوند.

مطالعهای در سال ۲۰۱۸ که بیش از ۱۴ میلیون توییت را در بازهی زمانی دهماهه بررسی کرد، نشان داد باتها نقش قابلتوجهی در انتشار اخبار از منابع غیرقابلاعتماد داشتهاند. این باتها با داشتن تعداد زیادی دنبالکننده، به اطلاعات نادرست مشروعیت میبخشیدند و باعث میشدند کاربران واقعی این محتوا را باور کرده و بازنشر کنند.

طبق مطالعات مستند؛ باتها نقش قابلتوجهی در انتشار اخبار از منابع غیرقابلاعتماد دارند

شاید چشمگیرترین نمونه را بتوانیم در کمپینهای گسترده دیساینفورمیشن طرفدار روسیه بینیم که هدف آنها تضعیف حمایت از اوکراین و ترویج احساسات طرفدار روسیه بود. هنوز مدت زیادی از این کمپینها نگذشته و اغلب ما آنها را به یاد داریم.

این کمپینهای هماهنگ که توسط فعالان و روزنامهنگاران کشف شدند، از باتها و هوش مصنوعی برای تولید و انتشار اطلاعات جعلی استفاده میکردند و به میلیونها کاربر شبکههای اجتماعی میرسیدند.

تأثیر عمیق بر کسبوکارهای آنلاین

اما گسترهی تأثیر باتها از سیاست فراتر میرود. حالا شرکتهای فناوری و کسبوکارهای آنلاین با چالشی جدی روبرو هستند: چگونه میتوان تشخیص داد کدام تعامل واقعی است و کدام مصنوعی؟

تقریباً همهی ما انگیزهی اول تعاملات فیک را بهوضوح میدانیم: تعامل در شبکههای اجتماعی به درآمد تبلیغاتی منجر میشود. اگر شخصی اکانتی داشته باشد که تعاملات بالایی دریافت میکند، میتواند سهمی از درآمد تبلیغاتی پلتفرمهایی مانند متا را دریافت کند.

یکی از انگیزههای بهرهگیری از باتها در شبکههای اجتماعی، کسب درآمد تبلیغاتی است

اما مسئله پیچیدهتر از درآمدزایی ساده به نظر میرسد. این حسابهای با تعاملات بالا (که بسیاری از دنبالکنندگانشان جعلی هستند، اما برخی واقعی) بهتدریج مشروعیت پیدا میکنند. این یعنی ارتشی از حسابهای کاربری در حال شکلگیری است که میتوانند به بالاترین پیشنهاددهنده فروخته شوند و در جهت اهداف پشتپرده حرکت کنند.

مشکل هجوم باتها زمانی اهمیت بیشتری پیدا میکند که بدانیم بسیاری از کاربران شبکههای اجتماعی را منبع اصلی اخبار روزانه میدانند:

برای مثال طبق آمار سال ۲۰۲۳ استرالیا، ۴۶ درصد از افراد ۱۸ تا ۲۴ساله برای چککردن اخبار به شبکههای اجتماعی محبوبشان مراجعه میکردند، درحالیکه این آمار در سال ۲۰۲۲ حدود ۲۸ درصد بود. در سایر کشورها نیز سوشالمدیا از رسانههای سنتی مانند رادیو و تلویزیون پیشی گرفته است.

ارتشی از حسابهای کاربری جعلی ساخته میشوند تا در جهت اهداف پشتپرده حرکت کنند

همین تغییر در منبع دریافت اطلاعات، بازار سیاه تأثیرگذاری را بهشدت سودآور میکند. حالا شبکههای پیچیدهای از باتها میتوانند به سفارش مشتریان خود، هر پیامی را تقویت کنند، افکار عمومی را شکل دهند و حتی بر تصمیمات خرید مصرفکنندگان تأثیر بگذارند.

آیا نظریه اینترنت مرده واقعیت دارد؟

اگر مسیر کنونی ادامه پیدا کند، آیندهی اینترنت میتواند بسیار متفاوت از چیزی باشد که تیم برنرز لی، مخترع وب جهانی، در ذهن داشت.

هوش مصنوعی در حال تغییر ماهیت تعاملات آنلاین است. چتباتها جایگزین پشتیبانی انسانی در بسیاری از وبسایتها شدهاند و گاهی چنان طبیعی صحبت میکنند که کسی به ماهیت غیرانسانی آنها شک نمیکند. مرز بین تعامل انسانی و مصنوعی هر روز مبهمتر میشود.

تئوری اینترنت مرده هنوز کاملاً واقعیت ندارد. انسانها همچنان بخش عمده محتوا و مکالمات را در توییتر، ردیت، فیسبوک و تیکتاک خلق میکنند، اما به نظر میرسد این نظریهی توطئه میتواند روزی به واقعیتی ناخوشایند تبدیل شود.

هوش مصنوعی هنوز نمیتواند محتوای واقعاً خوب تولید کند

واقعیت این است که هوش مصنوعی هنوز نمیتواند محتوای واقعاً خوب تولید کند، عمدتاً به این دلیل که بستر مفهومی موضوعات و مباحث و جوامع را مثل ما درک نمیکند. اکثر پستهایی که وایرال میشوند، بذلهگوییها، نکتهسنجیها، مشاهدات هوشمندانه و بازتعریف وقایع آشنا در پسزمینههای جدید را هنوز انسانها ارسال میکنند.

اینترنت ممکن است کسلکننده، ناکارآمد، اسپمی و الگوریتمی به نظر برسد، اما ما تنها در دریایی از NPCهای الکترونیکی شناور نیستیم. به جز بازنشر محتوای تولید شده توسط افراد، رباتها اینترنت را به شیوهای که نظریه پیشنهاد میکند هدایت نمیکنند: اینفلوئنسرها این کار را انجام میدهند و رباتها از آنها پیروی میکنند.

بسیاری از نکاتی که در «مرجع اصلی نظریه» آمده، حقیقت دارند و در سالهای اخیر مرتبطتر هم شدهاند. بهعنوانمثال، الگوریتمها تجربهی مرور وب را به ما دیکته میکنند و میتوانند پستهای وایرال را ایجاد یا نابود کنند.

پلتفرمهای اجتماعی دستکم روی کاغذ مدعی هستند که با این سوءاستفادهها مقابله میکنند. به طور خاص ایلان ماسک گفته بود گزینههایی برای الزام کاربران X به پرداخت حق عضویت بررسی میکند تا از این طریق جلوی پیشرفت مزارع بات (Bot Farms) را بگیرد. غولهای شبکههای اجتماعی قادرند حجم زیادی از فعالیتهای باتهای شناسایی شده را حذف کنند، البته اگر چنین تصمیمی بگیرند.

حالا صداهای انسانی در میان انبوهی از محتواهای الگوریتمی گم میشود

شاید وقتی تیم برنرزلی نارضایتی خود را از وضعیت کنونی وب ابراز میکند، به همین آینده فکر میکند. اینترنتی که در آن، صداهای انسانی در میان انبوهی از محتوای الگوریتمی گم میشوند و تعامل واقعی انسانی حکم کالایی کمیاب را دارد.

مسلماً هنوز چیزهای جالب و مفیدی در فضای آنلاین اتفاق میافتد، اما پیداکردن آنها روزبهروز دشوارتر میشود و روندها بهسرعت با کمپینهای بازاریابی درهم میآمیزند. نمونههای اخیر مانند «لیوان استنلی» و حتی «شیک گریمیس» نشان میدهند چگونه مرز بین محتوای ارگانیک و تبلیغات برنامهریزی شده نامرئی میشود.

متا، شرکت مادر فیسبوک، در گزارش سهماههی آخر ۲۰۲۳ خود از حذف بیش از یک و نیم میلیارد حساب جعلی خبر داد. این شرکت تشریح کرده بود از سیستمهای پیشرفتهی یادگیری ماشین برای شناسایی الگوهای مشکوک استفاده میکند. وقتی حسابی در روز صدها پست منتشر میکند یا در ساعات غیرمعمول فعالیت دارد، زنگ خطر سیستمها را به صدا درمیآورد. (البته هنوز اقدامات متا در پایان سال ۲۰۲۴ را نمیدانیم.)

در برخی موارد شرکتها میخواهند از فناوری بلاکچین استفاده کنند؛ زیرا این فناوری میتواند مانند اثر انگشت دیجیتال عمل کند و اصالت هر محتوا را تضمین کند. سیستمهای جدید واترمارک نیز به طور خودکار محتوای تولید شده توسط هوش مصنوعی را علامتگذاری میکنند، تا کاربران بدانند با چه چیزی روبرو هستند.

باتهای خوب، باتهای بد

هنگامیکه از اصطلاح بات حرف میزنیم، دقیقاً به چه پدیدهای اشاره داریم؟ بات در واقع برنامه یا کد منفردی نیست که یک نوع کار را انجام بدهد. این اصطلاح تقریباً به هر چیزی اطلاق میشود که با کدهای برنامهنویسی (از پایتون گرفته تا جاوا، جاوا اسکریپت و دیگر زبانها) توسعهیافته و اقداماتی انجام میدهد که در وقت مردم صرفهجویی میکند.

باتها از زمان تولد اینترنت وجود داشتهاند. به نحوهی کار گوگل فکر کنید: بدون باتهای خوب مانند وب کراولرها تجربیاتی مثل وبگردی وجود نداشت. اما تقریباً از همان سالها باتها بد هم بهسرعت برای مقاصدی نظیر کلیکهای تقلبی و سرقت داده تکثیر شدند.

برخلاف انسانها، باتها خستگیناپذیرند و به تعطیلات آخر هفته نیاز ندارند. آنها بسیار سریع یاد میگیرند و کارها را با شتاب خیرهکنندهای پیش میبرند. اما قدرت باتها بد برای اقدامهای بهظاهر عادی و ساده مثل کامنت گذاشتن در وبسایتها، باانگیزههای مخرب ورای تصور ما است.

حتی باتهای خوب هم بهراحتی در دست افراد سودجو به ابزارهای آسیبزا تبدیل میشوند

البته باتهای خوب بهراحتی در دست افراد سودجو به ابزاری برای آسیبهای متنوع تبدیل میشوند. نمونهی جالب این دوگانگی را در بازار سهام میبینیم: الگوریتمهای معاملاتی خودکار به افزایش نقدینگی و کارایی بازار کمک میکنند، اما در سال ۲۰۱۰ به مدت ۳۶ دقیقه باعث سقوط ناگهانی بازار بورس شدند؛ رویدادی که در آن میلیاردها دلار ارزش سهام از دست رفت و مجدداً بازیابی شد.

کدهایی که در ردیف باتهای بد جای میگیرند، همان مواردی هستند که در مراحل قبل از آنها صحبت کردیم: باتهایی که تعاملات فیک ایجاد میکنند، وظیفهی انتشار دیساینفورمیشن را به عهده دارند، افکار عمومی را دستکاری میکنند و نهایتاً باتهایی که محتوای بیارزش تولید میکنند.

تشخیص خوب و بد بودن باتها، عموماً به زمینهی استفاده از آنها بستگی دارد. باتهای تشخیص محتوای نامناسب یوتیوب از کودکان محافظت میکنند، اما همین سیستمها گاهی منجر به حذف محتوای مشروع و سانسور ناخواسته میشوند.

درواقع مشکل کلیدی باتهای خوب هم شفاف نبودن آنها است. وقتی نمیدانیم چه زمانی با یک بات تعامل میکنیم، وقتی نمیتوانیم تشخیص دهیم یک پست توسط انسان نوشته شده یا ماشین و وقتی مطمئن نیستیم دادههای ما چگونه توسط این سیستمها پردازش میشوند، احساس ناامنی و بیاعتمادی ما افزایش مییابد.

اما در این میان چگونه میتوان به تعادل درست دستیافت؟ چگونه میتوانیم از مزایای اتوماسیون و هوش مصنوعی بهره ببریم بدون اینکه اصالت تعاملات انسانی را قربانی کنیم یا کارایی و شفافیت را همزمان در دست داشته باشیم؟

کلید حل چالش باتها: قانونگذاری یا آموزش؟

اتحادیهی اروپا با تصویب قانون خدمات دیجیتال (DSA)، پیشگام مقابلهی قانونی با این چالش بود. DSA پلتفرمهای بزرگ را ملزم به شفافسازی الگوریتمها و برچسبگذاری محتوای مصنوعی میکرد و جریمههای سنگینی نیز برای سوءاستفاده از باتها در تبلیغات و تأثیرگذاری سیاسی در نظر گرفته بود.

همچنین در بسیاری از کشورهای دیگر هم قانونگذاران به فکر تدوین مقررات جدیدی برای احراز هویت کاربران در شبکههای اجتماعی افتادهاند. اما حضور دولتها در این حوزه موافقان و مخالفان زیادی دارد و اغلب فعالین آزادی وب هرگونه تعیین تکلیفکردن دولتی را با اصول «حق گمنام ماندن» مغایر میدانند.

کاربرانی که نشانههای محتوای مصنوعی را تشخیص میدهند، کمتر قربانی دستکاریهای آنلاین میشوند

بااینحال همه روی یک هدف توافق دارند: اینترنت باید دوباره به محلی برای تعاملات انسانی تبدیل شود نه لشکر باتها.

از طرف دیگر نتایج مطالعات نشان میدهد آموزش سواد دیجیتال میتواند تغییر بزرگی ایجاد کند. کاربرانی که یاد میگیرند نشانههای محتوای مصنوعی را تشخیص دهند و با چگونگی کار الگوریتمهای شبکههای اجتماعی آشنا میشوند، کمتر قربانی دستکاریهای آنلاین میشوند.

باتها و الگوریتمها تا کجا فرمانروایی میکنند؟

آیندهای که دادهها ترسیم میکنند، پیچیده بهنظر میرسد.

تنها در دو سال گذشته، حجم محتوای هوش مصنوعی ۳۰۰ درصد افزایشیافته، اعتماد کاربران به محتوای آنلاین ۴۰ درصد کاهش پیدا کرده و هزینههای مقابله با تقلب دیجیتال ۲۰۰ درصد بیشتر شده است. تا پایان سال ۲۰۲۵، احتمالاً سهچهارم محتوای آنلاین مصنوعی یا غیرانسانی تولید خواهد شد. هزینهی رفع آسیبهای وارده و مقابله با این چالشها به ده میلیارد دلار خواهد رسید و تعداد باتهای پیچیده هر سال ۴۰ درصد افزایش خواهد یافت.

تا پایان سال ۲۰۲۵، احتمالاً سهچهارم محتوای آنلاین غیرانسانی تولید خواهد شد

پلتفرمهای اجتماعی حالا در نقطهای حساس قرار دارند. آنها باید بین رشد و سودآوری از یک سو و حفظ اصالت و اعتماد از سوی دیگر، تعادل ایجاد کنند. درحالیکه فشار برای افزایش درآمد و تعامل بیشتر نرخی صعودی را تجربه میکند، نیاز به فضایی سالم برای ارتباطات انسانی واقعی نیز بیش از همیشه احساس میشود.

نظریه اینترنت مرده را در ذهن داشته باشید

نظریه اینترنت مرده واقعاً ادعا نمیکند که بیشتر تعاملات شخصی شما در اینترنت جعلی هستند. بااینحال ایدهی بنیادی تئوری، لنزی جالب برای مشاهدهی اینترنت به شمار میرود: اینکه وب جهانی دیگر برای انسانها و توسط انسانها خلق نمیشود و پدیدهای که به نام اینترنت میشناختیم و دوست داشتیم، «مرده» است.

آزادی به اشتراک گذاشتن افکارمان در اینترنت و رسانههای اجتماعی، این فضا را بسیار قدرتمند کرد و این همان قدرتی است که عوامل بد میخواهند کنترلش را در دست خود داشته باشند.

تئوری اینترنت مرده به ما یادآوری میکند که شکاک باشیم و در رسانههای اجتماعی و سایر وبسایتها با ذهنی نقاد حرکت کنیم. هر تعامل، روند و بهخصوص «حس و نگرش کلی» میتواند کاملاً مصنوعی باشد: چیزی که به طور هدفمند طراحی شده تا قدمبهقدم نگاه شما را به جهان تغییر دهد.