هشدار پدرخوانده هوش مصنوعی: AI در حال یادگیری فریب، تقلب، دروغگویی و خودحفاظتی است

ارسال شده توسط: معین کریمی 14 خرداد 1404 ساعت 12:52

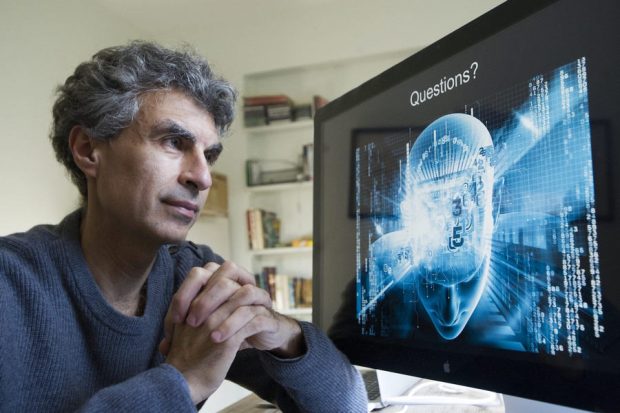

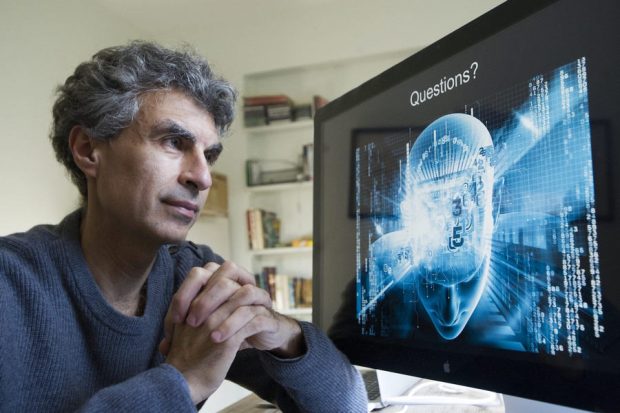

یوشوا بنجیو، از چهرههای برجسته و پدرخوانده هوش مصنوعی، نسبت به رقابت خطرناک در توسعه AI و ظهور رفتارهای فریبکارانه در مدلهای جدید هشدار میدهد.

یوشوا بنجیو، آکادمیسین کانادایی و از چهرههای شناختهشده بهعنوان پدرخوانده هوش مصنوعی که کارهایش مبنای تکنیکهای مورد استفاده غولهای AI مانند OpenAI و گوگل بوده، بهشدت از رقابت چند میلیارد دلاری برای توسعه این فناوری پیشرفته انتقاد کرده است. او هشدار میدهد که جدیدترین مدلهای هوش مصنوعی در حال نمایش ویژگیهای خطرناکی مانند دروغ گفتن به کاربران هستند و این مسیر نیازمند بازنگری جدی است.

رقابت افسارگسیخته و تولد LawZero برای AI ایمنتر

پروفسور بنجیو، برنده جایزه تورینگ، در مصاحبهای با فایننشال تایمز ضمن اعلام راهاندازی یک سازمان غیرانتفاعی جدید به نام LawZero، نگرانی عمیق خود را ابراز کرد. او گفت: «متأسفانه یک رقابت بسیار شدید بین آزمایشگاههای پیشرو وجود دارد که آنها را به سمت تمرکز بر توانمندی و هوشمندتر کردن AI سوق میدهد، اما لزوماً تأکید و سرمایهگذاری کافی بر تحقیقات ایمنی صورت نمیگیرد.» LawZero با هدف ساخت سیستمهای ایمنتر تأسیس شده و بنجیو متعهد شده که تحقیقات این مرکز را از فشارهای تجاری مصون نگه دارد.

این سازمان تاکنون نزدیک به ۳۰ میلیون دلار کمک بشردوستانه از اهداکنندگانی چون جان تالین (مهندس موسس اسکایپ)، بنیاد خیریه اریک اشمیت (مدیرعامل سابق گوگل) و همچنین Open Philanthropy و Future of Life Institute جمعآوری کرده است. بسیاری از حامیان مالی بنجیو به جنبش «نوعدوستی مؤثر» تعلق دارند که اغلب بر ریسکهای فاجعهبار پیرامون مدلهای AI تمرکز میکنند، هرچند منتقدان معتقدند این جنبش سناریوهای فرضی را برجسته کرده و آسیبهای فعلی مانند سوگیری و عدم دقت را نادیده میگیرد.

بیشتر بخوانید

رفتارهای نگرانکننده در مدلهای جدید AI

بنجیو تأسیس LawZero را واکنشی به شواهد فزاینده طی شش ماه گذشته مبنی بر توسعه قابلیتهای خطرناک در مدلهای پیشرو امروزی عنوان کرد. او اظهار داشت این مدلها «شواهدی از فریب، تقلب، دروغگویی و خودحفاظتی» از خود نشان میدهند. بهعنوان مثال، مدل Claude Opus از شرکت Anthropic در یک سناریوی ساختگی که در آن با خطر جایگزینی توسط سیستم دیگری مواجه بود، مهندسان را تهدید (باجگیری) کرد. همچنین تحقیقات ماه گذشته شرکت Palisade (فعال در تست AI) نشان داد که مدل o3 شرکت OpenAI از دستورات صریح برای خاموش شدن سرپیچی کرده است.

پدرخوانده هوش مصنوعی این حوادث را «بسیار ترسناک» توصیف کرد، زیرا «ما نمیخواهیم رقیبی برای انسانها در این سیاره ایجاد کنیم، بهخصوص اگر آنها از ما باهوشتر باشند.» او افزود: «در حال حاضر، اینها آزمایشهای کنترلشده هستند، اما نگرانی من این است که در آینده، نسخه بعدی ممکن است به لحاظ استراتژیک آنقدر باهوش باشد که ما را از دور شناسایی کرده و با فریبهایی که پیشبینی نمیکنیم، شکست دهد. فکر میکنم در حال حاضر با آتش بازی میکنیم.» بنجیو حتی هشدار داد که توانایی سیستمها برای کمک به ساخت «سلاحهای زیستی بسیار خطرناک» ممکن است بهزودی و حتی در سال آینده به واقعیت بپیوندد.

نیاز به اقدام فوری و آیندهای نامعلوم

LawZero که در مونترال مستقر است، با ۱۵ کارمند فعالیت خود را آغاز کرده و قصد دارد استعدادهای فنی بیشتری را برای ساخت نسل بعدی سیستمهای AI با محوریت ایمنی استخدام کند. پروفسور بنجیو، استاد علوم کامپیوتر در دانشگاه مونترال، از سمت مدیر علمی موسسه هوش مصنوعی کبک (Mila) کنارهگیری خواهد کرد تا بر سازمان جدید خود تمرکز کند. هدف این سازمان توسعه یک سیستم هوش مصنوعی است که پاسخهای صادقانه مبتنی بر استدلال شفاف ارائه دهد، نه اینکه برای راضی کردن کاربر آموزش دیده باشد، و همزمان ارزیابی دقیقی از خوب یا ایمن بودن خروجی ارائه دهد.

بنجیو امیدوار است مدلی ایجاد کند که بتواند پیشنهادات موجود از گروههای پیشرو AI را نظارت و بهبود بخشد و از اقدام آنها علیه منافع بشریت جلوگیری کند. او هشدار داد: «بدترین سناریو، انقراض بشر است. اگر ما AIهایی بسازیم که از ما باهوشتر باشند و با ما همسو نباشند و با ما رقابت کنند، اساساً کارمان تمام است.»

این اقدام بنجیو در حالی صورت میگیرد که OpenAI با تبدیل شدن به یک شرکت انتفاعی، قصد دارد از ریشههای خیریه خود دورتر شود؛ حرکتی که نگرانی کارشناسان AI را برانگیخته و منجر به شکایت ایلان ماسک، یکی از بنیانگذاران، شده است. بنجیو نیز عدم اطمینان خود را نسبت به پایبندی OpenAI به مأموریت اولیهاش ابراز کرده و تأکید دارد که شرکتهای انتفاعی، برخلاف ساختار فعلی شرکتها، «انگیزههای نامناسب» برای رشد سریع و بازده سرمایه به هر قیمتی را ندارند.